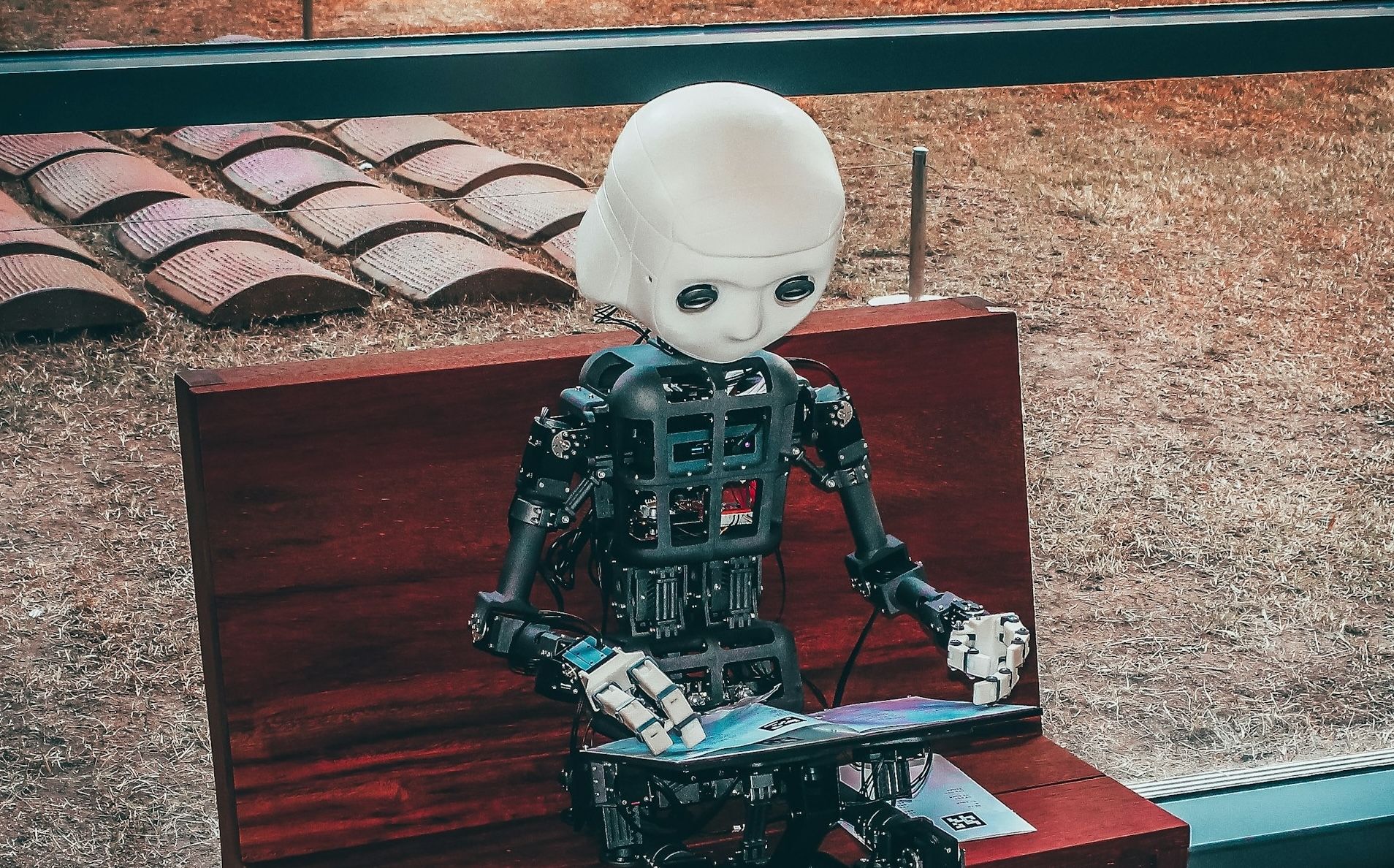

Los Desafíos Éticos de la IA

Cómo la tecnología que impulsa el futuro plantea dilemas morales que no podemos ignorar.

Octubre 30, 2025

La Inteligencia Artificial (IA) está transformando nuestro mundo a una velocidad sin precedentes, revolucionando sectores desde la salud hasta las finanzas y más allá. Aunque los beneficios potenciales de la IA son inmensos, también plantea importantes consideraciones éticas que debemos atender para asegurar un futuro justo y equitativo. En este blog exploraremos los principales desafíos éticos de la IA y cómo podemos enfrentarlos de manera responsable.

1. Sesgo e Imparcialidad

Los sistemas de IA aprenden a partir de datos, y si esos datos contienen sesgos, la IA inevitablemente los replicará. Esto puede conducir a resultados discriminatorios en ámbitos críticos como la contratación, los préstamos o la aplicación de la ley. Por ejemplo, una IA utilizada en procesos de selección podría favorecer a candidatos masculinos si fue entrenada con datos históricos sesgados. De igual modo, un sistema de policía predictiva podría dirigir su atención de forma desproporcionada hacia determinadas comunidades minoritarias si los datos reflejan sesgos históricos.

2. Cómo Abordar el Sesgo

Conjuntos de Datos Diversos: Es fundamental que los datos de entrenamiento sean representativos e inclusivos de todos los grupos demográficos. Esto implica recopilar información de diversas fuentes y procurar la inclusión de grupos subrepresentados. Técnicas como el sobremuestreo de clases minoritarias pueden ayudar a equilibrar los conjuntos de datos.

Auditorías de Sesgo: Realizar auditorías periódicas a los sistemas de IA permite detectar y medir sesgos en sus resultados mediante herramientas y métricas específicas. Estas evaluaciones pueden incluir indicadores estadísticos, métricas de equidad y análisis del impacto en el mundo real.

Transparencia: Hacer comprensible el proceso de toma de decisiones de la IA genera confianza. Las técnicas de interpretabilidad del modelo permiten explicar los factores que influyen en las decisiones, fomentando la transparencia y posibilitando que las partes interesadas cuestionen o validen los resultados.

3. Privacidad de los Datos

La IA suele requerir grandes volúmenes de datos personales para funcionar de manera efectiva, lo que plantea preocupaciones sobre la privacidad y el posible mal uso de la información. Por ejemplo, la tecnología de reconocimiento facial puede utilizarse con fines de vigilancia, vulnerando derechos individuales, mientras que los datos médicos usados en diagnósticos basados en IA podrían quedar expuestos si no se protegen adecuadamente.

Protegiendo la Privacidad

Anonimización de Datos: Aplicar técnicas que eliminen o encripten información de identificación personal (PII) evita que las personas puedan ser reconocidas fácilmente. Métodos como la privacidad diferencial añaden ruido a los datos para proteger identidades individuales sin comprometer el análisis agregado.

Controles de Acceso Rigurosos: Restringir el acceso a información sensible asegura que solo el personal autorizado pueda verla o manipularla, mediante autenticación segura, encriptación y control de permisos.

Cumplimiento Normativo: Cumplir con leyes como el Reglamento General de Protección de Datos (GDPR) o la Ley de Privacidad del Consumidor de California (CCPA) garantiza los derechos de los titulares de los datos, permitiéndoles controlar, portar o eliminar su información personal.

4. Desplazamiento Laboral

A medida que la IA automatiza tareas repetitivas, surge la preocupación por el desplazamiento de trabajadores. Aunque la tecnología puede crear nuevas oportunidades laborales, la transición puede ser difícil para quienes desempeñan funciones tradicionales. Por ejemplo, la automatización en la manufactura puede reducir empleos en líneas de producción, pero generar nuevas posiciones en mantenimiento y supervisión de sistemas de IA.

Mitigando el Impacto Laboral

Programas de Recapacitación: Es esencial invertir en la formación de trabajadores para adquirir habilidades relevantes en la economía impulsada por la IA. Gobiernos, empresas e instituciones educativas deben colaborar para ofrecer capacitación en IA, ciencia de datos y automatización avanzada.

Aprendizaje Continuo: Fomentar una cultura de educación constante y adaptación es clave. Los cursos en línea, talleres y certificaciones permiten a los profesionales mantenerse actualizados ante los rápidos cambios tecnológicos.

Redes de Apoyo: Implementar sistemas de apoyo social, como beneficios por desempleo, asesoramiento profesional y servicios de recolocación laboral, facilita la transición hacia nuevos sectores y reduce el impacto económico del cambio tecnológico.

5. Desarrollo Ético de la IA

El desarrollo y despliegue de la IA deben guiarse por principios éticos que prevengan daños y garanticen que la tecnología beneficie a toda la sociedad. Esto requiere decisiones conscientes sobre cómo se diseña y aplica la IA, además de asegurar la rendición de cuentas.

Promoviendo una IA Ética

Directrices Éticas: Crear y seguir marcos éticos claros —basados en imparcialidad, transparencia, responsabilidad y respeto por los derechos humanos— es esencial. Estas pautas deben integrarse en todas las etapas del ciclo de vida del desarrollo de la IA.

Participación de las Partes Interesadas: Involucrar a diferentes actores, especialmente comunidades vulnerables, permite incorporar múltiples perspectivas. Esto puede lograrse mediante consultas públicas, talleres o metodologías de diseño participativo.

Mecanismos de Responsabilidad: Establecer organismos de supervisión, registros de auditoría y mecanismos de reparación asegura que existan consecuencias cuando un sistema de IA causa daño o discrimina.

6. Toma de Decisiones Autónoma

Los sistemas de IA que toman decisiones críticas —como vehículos autónomos o herramientas médicas— deben garantizar que sus acciones se realicen de manera ética y segura. Un auto autónomo, por ejemplo, debe decidir en milisegundos ante emergencias, mientras que un sistema de diagnóstico asistido por IA debe priorizar siempre la seguridad y bienestar del paciente.

El futuro de la inteligencia artificial ofrece un potencial enorme, pero también exige responsabilidad. Solo al priorizar la equidad, la privacidad y la rendición de cuentas, y al apoyar a quienes se ven afectados por la transformación tecnológica, podremos aprovechar el poder de la IA para el bien común. Desarrolladores, legisladores y usuarios compartimos la responsabilidad de construir un futuro donde la IA sea ética, inclusiva y humana.

Últimas PerspectivasNuestras Perspectivas más Recientes

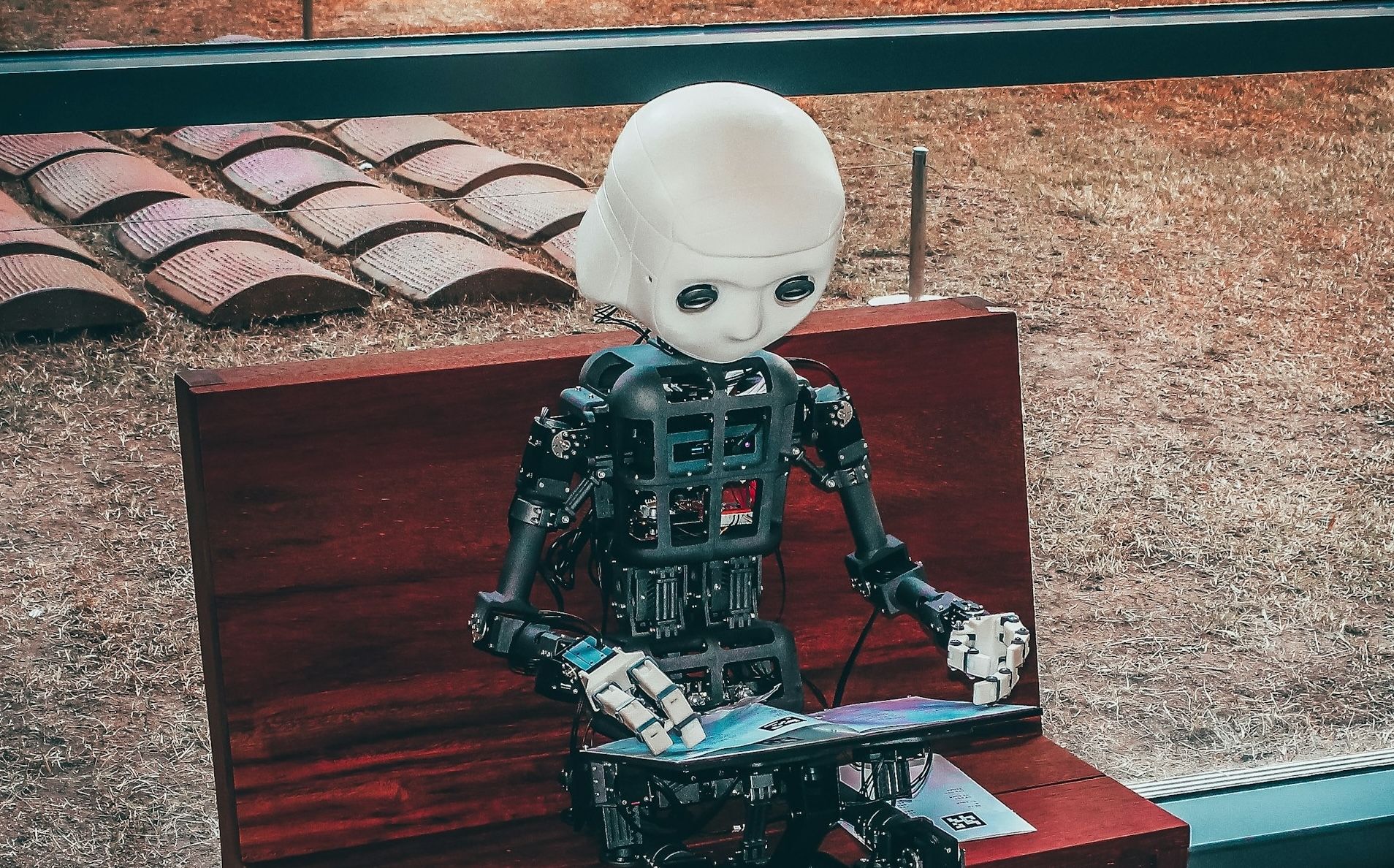

Los Desafíos Éticos de la IA

La IA transforma industrias, pero plantea retos éticos como sesgos, privacidad, impacto laboral y decisiones autónomas. Para un futuro justo, se requiere datos inclusivos, transparencia, protección de la información y capacitación laboral.

Octubre 30, 2025

Tecnología

Panorama del talento de Salesforce

Accede a información clave sobre el ecosistema de Salesforce en Latinoamérica. Este ebook explora las tendencias de certificación, la distribución del talento por país y los niveles de experiencia para ayudarte a contratar talento nearshore.

Agosto 12, 2025

eBook